Preludio

Hemos construido agentes con ambas herramientas. No ejemplos de juguete, no demos de hola-mundo, sino agentes en produccion que manejan peticiones reales de usuarios, llaman a APIs reales y fallan de maneras reales. Esa experiencia es de donde parte esta guia.

Cuando Anthropic publico el Agent SDK, la primera reaccion fue escepticismo. Despues de usar LangChain durante mas de un ano con cadenas, agentes y flujos de trabajo de LangGraph ejecutandose en produccion, ¿por que reescribir algo?

La respuesta resulto ser matizada. No todo se reescribio. Pero varios agentes se migraron al Agent SDK, mientras que otros permanecieron en LangChain. La decision nunca fue sobre cual herramienta es "mejor" en abstracto. Siempre fue sobre cual herramienta encaja en el problema especifico.

Esta guia recorre ese proceso de decision. Te mostraremos ambas arquitecturas, construiremos el mismo agente en ambos frameworks y te daremos un marco claro para elegir entre ellos. Si ya has leido nuestra guia sobre construir un agente personalizado de Claude, esto extendera ese conocimiento a un contexto comparativo. Si empiezas desde cero, esta guia se sostiene por si sola.

El problema

El ecosistema de agentes de IA en 2026 tiene una paradoja. Hay mas herramientas que nunca para construir agentes, pero la eleccion entre ellas es mas dificil que nunca. Cada framework afirma ser el mas simple, el mas potente, el mas listo para produccion. El marketing es indistinguible.

Las diferencias reales son arquitectonicas. Se manifiestan cuando intentas hacer algo especifico. Cuando necesitas anadir un guardrail. Cuando necesitas cambiar un modelo. Cuando necesitas depurar una llamada a herramienta que fallo a las 3 de la manana.

Cuando necesitas delegar de un agente a otro en mitad de una conversacion.

Los dos frameworks sobre los que mas preguntan los desarrolladores son el Agent SDK de Anthropic y LangChain. Son genuinamente diferentes en filosofia, arquitectura y caso de uso previsto. Elegir el incorrecto te cuesta semanas de refactorizacion. Elegir el correcto te ahorra meses.

Esto es lo que aprendimos.

El camino

Que es realmente el Claude Agent SDK

El Claude Agent SDK es la biblioteca oficial de Anthropic para construir aplicaciones agénticas con Claude. Esta disponible tanto en Python como en TypeScript. La idea central es directa.

Defines un Agent con un nombre, un modelo, instrucciones y un conjunto de herramientas. Llamas a agent.run() con un mensaje del usuario. El SDK se encarga de todo lo demas.

"Todo lo demas" significa el bucle agéntico. El SDK envia tu mensaje a Claude. Claude decide si responder directamente o llamar a una herramienta. Si llama a una herramienta, el SDK ejecuta esa herramienta, envia el resultado de vuelta a Claude y deja que Claude decida de nuevo. Este bucle continua hasta que Claude produce una respuesta final sin mas llamadas a herramientas.

Asi es como se ve un agente minimo en Python.

from agents import Agent, Runner, function_tool

@function_tool

def get_weather(city: str) -> str:

"""Get current weather for a city."""

return f"Weather in {city}: 18°C, partly cloudy"

agent = Agent(

name="Weather Agent",

model="claude-sonnet-4-6",

instructions="You help users check the weather. Be concise.",

tools=[get_weather]

)

result = Runner.run_sync(agent, "What's the weather in London?")

print(result.final_output)

Eso es todo. Sin configuracion de cadenas, sin ensamblaje de plantillas de prompt, sin configuracion de executor. Defines lo que el agente sabe, lo que puede hacer y lo que deberia decir. El SDK ejecuta el bucle.

El SDK tambien proporciona guardrails (funciones que validan entradas y salidas), handoffs (permitir que un agente delegue en otro) y enrutamiento de modelos (usar diferentes modelos de Claude para diferentes tareas). Estas son funcionalidades integradas de primera clase, no plugins que atornillas despues.

Que es LangChain

LangChain es una biblioteca de orquestacion agnóstica de framework para construir aplicaciones con modelos de lenguaje grandes. Soporta docenas de proveedores de modelos, cientos de integraciones y multiples arquitecturas de agentes.

Las abstracciones centrales de LangChain son cadenas, agentes, herramientas, memoria y retrievers. Una cadena es una secuencia de operaciones. Un agente es una cadena que usa un LLM para decidir que herramientas llamar.

Las herramientas son funciones que el agente puede invocar. La memoria almacena el historial de conversacion. Los retrievers obtienen documentos relevantes.

Asi se ve el mismo agente del tiempo en LangChain.

from langchain_anthropic import ChatAnthropic

from langchain.agents import create_tool_calling_agent, AgentExecutor

from langchain_core.prompts import ChatPromptTemplate

from langchain_core.tools import tool

@tool

def get_weather(city: str) -> str:

"""Get current weather for a city."""

return f"Weather in {city}: 18°C, partly cloudy"

llm = ChatAnthropic(model="claude-sonnet-4-6")

prompt = ChatPromptTemplate.from_messages([

("system", "You help users check the weather. Be concise."),

("placeholder", "{chat_history}"),

("human", "{input}"),

("placeholder", "{agent_scratchpad}"),

])

agent = create_tool_calling_agent(llm, [get_weather], prompt)

executor = AgentExecutor(agent=agent, tools=[get_weather])

result = executor.invoke({"input": "What's the weather in London?"})

print(result["output"])

Mas codigo. Mas abstracciones. Pero tambien mas control explicito sobre la plantilla del prompt, el placeholder del historial del chat y el scratchpad del agente donde se acumulan los resultados de las llamadas a herramientas.

El poder de LangChain viene de esta explicitud. Puedes cambiar ChatAnthropic por ChatOpenAI y el resto del codigo sigue igual. Puedes anadir memoria, retrievers, parsers de salida y callbacks personalizados en cada etapa. Puedes construir flujos de trabajo complejos de multiples pasos con LangGraph, que modela el comportamiento del agente como una maquina de estados.

Comparacion de arquitectura

La diferencia arquitectonica fundamental es esta. El Agent SDK te da un bucle agéntico opinado. LangChain te da bloques de construccion componibles para construir el tuyo.

Con el Agent SDK, el bucle es interno. Llamas a Runner.run_sync() y el SDK gestiona el ciclo de mensaje, llamada a herramienta, ejecucion y respuesta. Influyes en el bucle a traves de instrucciones, definiciones de herramientas y guardrails. Pero no escribes el bucle en si.

Con LangChain, el bucle es externo. El AgentExecutor ejecuta un bucle, pero puedes reemplazarlo con LangGraph para control total sobre las transiciones de estado, ramificaciones y recuperacion de errores. Puedes definir exactamente que sucede cuando una herramienta falla, cuando el modelo alucina o cuando necesitas aprobacion humana en mitad del flujo de trabajo.

Piensalo asi. El Agent SDK es un coche con cambio automatico. Tu diriges, frenas, aceleras. La caja de cambios se encarga del cambio de marchas. LangChain es un coche con cambio manual y un kit de herramientas para construir tu propia transmision si lo deseas.

Ninguno es inherentemente mejor. El cambio automatico es mas rapido para la mayoria de la conduccion. El cambio manual te da mas control en situaciones especificas.

Construyendo un agente con herramientas lado a lado

Aqui va algo mas realista. Un agente de investigacion que puede buscar en la web, leer documentos y resumir hallazgos. Ambas implementaciones se muestran a continuacion para que puedas ver las diferencias practicas.

Version Agent SDK.

from agents import Agent, Runner, function_tool

import httpx

@function_tool

def search_web(query: str) -> str:

"""Search the web for information on a topic."""

response = httpx.get(

"https://api.search.example/v1/search",

params={"q": query, "limit": 5}

)

results = response.json()["results"]

return "\n".join(

f"- {r['title']}: {r['snippet']}" for r in results

)

@function_tool

def read_url(url: str) -> str:

"""Read the content of a web page."""

response = httpx.get(url)

return response.text[:5000]

@function_tool

def save_summary(title: str, content: str) -> str:

"""Save a research summary to the database."""

# Database logic here

return f"Summary '{title}' saved successfully."

research_agent = Agent(

name="Research Agent",

model="claude-sonnet-4-6",

instructions="""You are a research assistant. When given a topic:

1. Search the web for relevant sources

2. Read the most promising results

3. Synthesise a summary with citations

4. Save the summary""",

tools=[search_web, read_url, save_summary]

)

result = Runner.run_sync(

research_agent,

"Research the current state of quantum computing in 2026"

)

print(result.final_output)

Version LangChain.

from langchain_anthropic import ChatAnthropic

from langchain.agents import create_tool_calling_agent, AgentExecutor

from langchain_core.prompts import ChatPromptTemplate

from langchain_core.tools import tool

import httpx

@tool

def search_web(query: str) -> str:

"""Search the web for information on a topic."""

response = httpx.get(

"https://api.search.example/v1/search",

params={"q": query, "limit": 5}

)

results = response.json()["results"]

return "\n".join(

f"- {r['title']}: {r['snippet']}" for r in results

)

@tool

def read_url(url: str) -> str:

"""Read the content of a web page."""

response = httpx.get(url)

return response.text[:5000]

@tool

def save_summary(title: str, content: str) -> str:

"""Save a research summary to the database."""

return f"Summary '{title}' saved successfully."

llm = ChatAnthropic(model="claude-sonnet-4-6")

tools = [search_web, read_url, save_summary]

prompt = ChatPromptTemplate.from_messages([

("system", """You are a research assistant. When given a topic:

1. Search the web for relevant sources

2. Read the most promising results

3. Synthesise a summary with citations

4. Save the summary"""),

("placeholder", "{chat_history}"),

("human", "{input}"),

("placeholder", "{agent_scratchpad}"),

])

agent = create_tool_calling_agent(llm, tools, prompt)

executor = AgentExecutor(agent=agent, tools=tools, verbose=True)

result = executor.invoke({

"input": "Research the current state of quantum computing in 2026"

})

print(result["output"])

Las definiciones de herramientas son casi identicas. La diferencia esta en la orquestacion. La version del Agent SDK tiene menos boilerplate. La version de LangChain te da verbose=True para logging integrado paso a paso y control explicito sobre la plantilla del prompt.

Rendimiento y sobrecarga

Hicimos benchmarks de ambos frameworks en la misma tarea, ejecutando un agente con tres herramientas a traves de diez conversaciones secuenciales. Los resultados fueron instructivos.

El Agent SDK anadio aproximadamente 2-5ms de sobrecarga por llamada a herramienta mas alla de la latencia de la API. Su bucle es fino. Serializa la llamada a herramienta, ejecuta tu funcion y envia el resultado de vuelta. Hay muy poco sucediendo entre esos pasos.

LangChain anadio 10-30ms por llamada a herramienta. Esto no es porque LangChain sea lento. Es porque LangChain hace mas. Ejecuta callbacks en cada etapa, mantiene el estado de la cadena, gestiona actualizaciones de memoria y pasa por parsers de salida.

Cada uno de esos es util. Cada uno anade un pequeno coste.

Para la mayoria de las aplicaciones, esta diferencia es irrelevante. La llamada a la API en si toma de 500ms a 3 segundos. Unos 25ms adicionales de sobrecarga del framework son ruido. Pero si estas ejecutando agentes a escala con cientos de sesiones concurrentes, o si estas construyendo aplicaciones sensibles a la latencia, la sobrecarga minima del Agent SDK es una ventaja genuina.

El uso de memoria conto una historia similar. La huella del Agent SDK es pequena porque hace menos. La huella de LangChain es mayor porque mantiene mas estado, mas callbacks y mas abstracciones.

En nuestros benchmarks, un solo agente del Agent SDK consumia aproximadamente 15MB de memoria en reposo, mientras que un agente comparable de LangChain con callbacks y memoria configurados consumia aproximadamente 40MB. A escala, con cientos de agentes concurrentes, esa diferencia se acumula significativamente.

Soporte multimodelo

Aqui es donde LangChain tiene una ventaja estructural clara. LangChain soporta docenas de proveedores de modelos a traves de una interfaz unificada. Puedes cambiar Claude por GPT-4, Gemini, Llama, Mistral o cualquier otro modelo soportado cambiando una linea de codigo.

# Switch from Claude to GPT-4

from langchain_openai import ChatOpenAI

llm = ChatOpenAI(model="gpt-4o")

# Everything else stays the same

El Agent SDK es exclusivo de Claude por diseño. Esta construido para aprovechar al maximo las capacidades especificas de Claude, incluyendo el pensamiento extendido, los patrones de uso de herramientas y la forma en que Claude estructura sus respuestas. No puedes conectar un modelo diferente.

Si tu aplicacion debe soportar multiples proveedores de modelos, o si quieres la flexibilidad de cambiar modelos sin reescribir tu logica de agente, LangChain es la eleccion correcta. No hay solucion alternativa para esto en el Agent SDK.

Si tu aplicacion esta construida alrededor de Claude y quieres la integracion mas ajustada posible con las funcionalidades de Claude, el Agent SDK es la eleccion correcta. Obtienes acceso a optimizaciones especificas de Claude que una interfaz generica no puede proporcionar.

Guardrails y seguridad

El Agent SDK tiene soporte integrado de guardrails. Defines guardrails de entrada que se ejecutan antes de que el agente procese un mensaje y guardrails de salida que se ejecutan antes de que el agente devuelva una respuesta.

from agents import Agent, Runner, InputGuardrail, GuardrailFunctionOutput

async def check_for_pii(ctx, agent, input_text):

"""Block requests that contain personal information."""

pii_patterns = ["social security", "credit card", "passport number"]

contains_pii = any(p in input_text.lower() for p in pii_patterns)

return GuardrailFunctionOutput(

output_info={"contains_pii": contains_pii},

tripwire_triggered=contains_pii

)

agent = Agent(

name="Safe Agent",

model="claude-sonnet-4-6",

instructions="You are a helpful assistant.",

input_guardrails=[

InputGuardrail(guardrail_function=check_for_pii)

]

)

Cuando el guardrail se activa, el agente se detiene inmediatamente. No se ejecutan llamadas a herramientas. No se genera respuesta. El llamante recibe una senal clara de que la entrada fue rechazada.

LangChain no tiene guardrails integrados de la misma manera. Puedes lograr resultados similares a traves de callbacks personalizados, middleware o usando herramientas externas como Guardrails AI o NeMo Guardrails. Estos funcionan bien pero requieren dependencias adicionales y configuracion.

La diferencia practica es la profundidad de integracion. Los guardrails del Agent SDK son parte de la definicion del agente. Se ejecutan en el mismo contexto que el agente. Tienen acceso al mismo estado. Los guardrails de LangChain se atornillan, lo que te da mas flexibilidad en como implementarlos pero requiere mas configuracion.

Observabilidad y depuracion

Cuando un agente falla a las 3 de la manana, necesitas entender que sucedio. Ambos frameworks proporcionan herramientas de observabilidad, pero abordan el problema de manera diferente.

El Agent SDK proporciona hooks de ciclo de vida. Puedes adjuntar funciones que se ejecutan en cada etapa del bucle agéntico, capturando llamadas a herramientas, respuestas del modelo y tiempos de ejecucion. Estos datos son estructurados y predecibles porque el bucle en si es estructurado y predecible.

from agents import RunHooks, RunContextWrapper, Agent

class LoggingHooks(RunHooks):

async def on_tool_start(self, context, agent, tool):

print(f"[TOOL START] {tool.name}")

async def on_tool_end(self, context, agent, tool, result):

print(f"[TOOL END] {tool.name}: {result[:100]}")

result = await Runner.run(

agent,

"Check the weather",

run_hooks=LoggingHooks()

)

LangChain proporciona callbacks y se integra con LangSmith para observabilidad en produccion. LangSmith te da una traza completa de cada ejecucion de cadena, incluyendo contadores de tokens, latencias, entradas y salidas de herramientas y respuestas del modelo. Es un servicio alojado con dashboard, busqueda y alertas.

from langchain_core.callbacks import BaseCallbackHandler

class LoggingCallback(BaseCallbackHandler):

def on_tool_start(self, serialized, input_str, **kwargs):

print(f"[TOOL START] {serialized['name']}")

def on_tool_end(self, output, **kwargs):

print(f"[TOOL END] {output[:100]}")

executor = AgentExecutor(

agent=agent,

tools=tools,

callbacks=[LoggingCallback()]

)

Si quieres observabilidad autogestionada, ambos frameworks la soportan. Si quieres una plataforma de observabilidad gestionada, LangSmith es madura y esta bien integrada. El ecosistema del Agent SDK aun no tiene una plataforma gestionada equivalente, aunque puedes construir logging completo con el sistema de hooks.

Handoffs entre agentes y sistemas multiagente

Ambos frameworks soportan patrones multiagente, pero los mecanismos difieren.

El Agent SDK tiene un concepto de primera clase de handoffs. Un agente puede delegar en otro agente en mitad de la conversacion. El segundo agente toma el control, maneja la peticion y devuelve el control. Esto se define declarativamente en la configuracion del agente.

billing_agent = Agent(

name="Billing Agent",

model="claude-sonnet-4-6",

instructions="You handle billing questions.",

tools=[check_balance, process_refund]

)

support_agent = Agent(

name="Support Agent",

model="claude-sonnet-4-6",

instructions="You handle general support. For billing questions, hand off to the billing agent.",

handoffs=[billing_agent]

)

Cuando el agente de soporte determina que una pregunta es sobre facturacion, delega automaticamente al agente de facturacion. El agente de facturacion tiene sus propias herramientas, sus propias instrucciones y su propia configuracion de modelo. La delegacion es invisible desde la perspectiva del usuario.

LangChain logra patrones multiagente a traves de LangGraph. LangGraph modela el flujo de trabajo como una maquina de estados donde los nodos son agentes o funciones y las aristas definen transiciones.

from langgraph.graph import StateGraph, MessagesState

graph = StateGraph(MessagesState)

graph.add_node("support", support_node)

graph.add_node("billing", billing_node)

graph.add_conditional_edges(

"support",

route_to_agent,

{"billing": "billing", "support": "support", "end": "__end__"}

)

LangGraph es mas potente para flujos de trabajo complejos. Puedes definir ciclos, ramas condicionales, ejecucion paralela y pasos de aprobacion humana en el bucle. El modelo de handoffs del Agent SDK es mas simple pero cubre los patrones multiagente mas comunes con mucho menos codigo.

Cuando usar el Agent SDK

Usa el Agent SDK cuando estes construyendo aplicaciones centradas en Claude. Si Claude es tu modelo principal y no necesitas cambiarlo por otro proveedor, el SDK te da la integracion mas ajustada con el minimo boilerplate.

Usalo cuando quieras patrones de agente simples y fiables. El bucle agéntico integrado maneja bien el caso comun. Llamadas a herramientas, conversaciones multi-turno, guardrails y handoffs cubren la mayoria de las arquitecturas de agentes en produccion.

Usalo cuando quieras sobrecarga minima. El SDK es fino. No impone abstracciones que no necesitas. Si estas construyendo un agente enfocado que hace una cosa bien, el SDK se aparta de tu camino.

Usalo cuando necesites fiabilidad en produccion desde el primer dia. El SDK lo mantiene Anthropic. Esta probado contra el comportamiento real de Claude. Cuando el formato de llamada a herramientas de Claude cambia, el SDK se actualiza para coincidir. No necesitas esperar a que una integracion de terceros se ponga al dia.

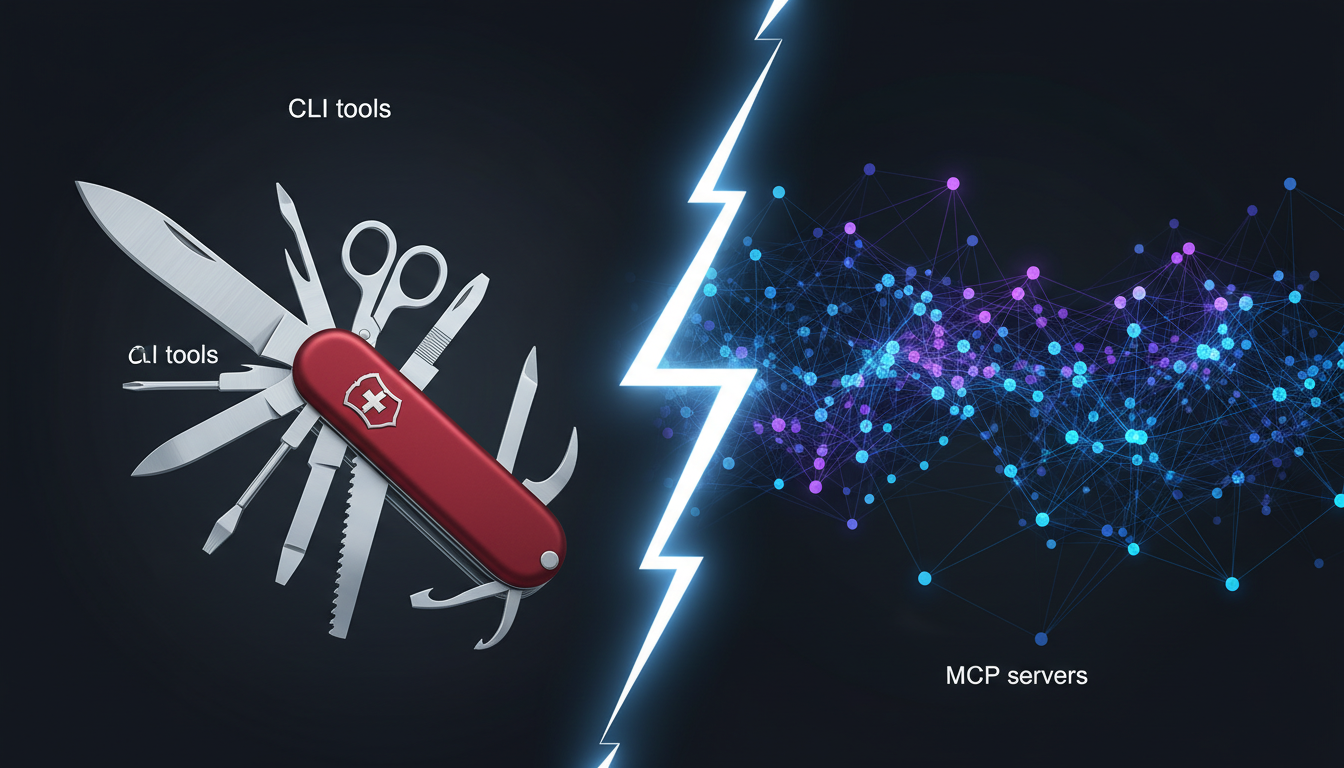

Si estas trabajando con servidores MCP y extensiones, el modelo de herramientas del Agent SDK se mapea naturalmente al protocolo de herramientas de MCP. Las herramientas definidas para el SDK se pueden adaptar para funcionar como herramientas MCP con cambios minimos.

Cuando usar LangChain

Usa LangChain cuando necesites soporte multimodelo. Si tu aplicacion debe funcionar con Claude, GPT-4, Gemini y modelos de codigo abierto a traves de la misma interfaz, LangChain esta construido para esto.

Usalo cuando necesites flujos de trabajo complejos. LangGraph te da maquinas de estados, enrutamiento condicional, ejecucion paralela y patrones de humano en el bucle que van mas alla de lo que el bucle agéntico del Agent SDK soporta.

Usalo cuando estes prototipando rapidamente. El enorme ecosistema de integraciones de LangChain significa que puedes conectarte a casi cualquier API, base de datos o servicio con un modulo preconstruido. Almacenes de vectores, cargadores de documentos, parsers de salida e implementaciones de memoria estan todos disponibles como componentes plug-and-play.

Usalo cuando tengas un código base existente en LangChain. La migracion tiene un coste real. Si tus agentes ya estan construidos en LangChain y funcionando en produccion, no hay razon urgente para reescribirlos. LangChain soporta Claude como modelo de primera clase a traves de langchain-anthropic.

Usalo cuando necesites herramientas de observabilidad maduras. LangSmith proporciona trazas, evaluacion y monitorizacion de grado de produccion listas para usar. Construir herramientas equivalentes sobre el Agent SDK es posible pero requiere mas trabajo.

Usando ambos juntos

Aqui va algo que no es obvio en la documentacion. Puedes usar ambos. LangChain puede usar Claude como su modelo subyacente a traves del paquete langchain-anthropic. Y puedes construir algunos agentes con el Agent SDK y otros con LangChain dentro de la misma aplicacion.

Este es un patron comun en produccion. Los agentes simples y enfocados usan el Agent SDK. Los flujos de trabajo complejos de multiples pasos usan LangGraph. Se comunican a traves de bases de datos compartidas y colas de mensajes, no a traves de integracion a nivel de framework.

Cada agente es un servicio. El framework que usa es un detalle de implementacion.

Aqui va un ejemplo concreto. Un sistema de atencion al cliente con tres agentes. El agente de triaje usa el Agent SDK. Lee el mensaje entrante, lo clasifica y delega a un agente especialista.

Los agentes especialistas tambien usan el Agent SDK porque son herramientas enfocadas de proposito unico con instrucciones claras y un conjunto pequeno de herramientas cada uno.

Pero el agente de informes que analiza tendencias de conversacion, genera resumenes semanales y produce visualizaciones usa LangGraph. Necesita orquestar multiples pasos con ramificacion condicional. Consulta una base de datos, ejecuta analisis estadistico, genera graficos con una herramienta de interprete de codigo y compila todo en un informe. El modelo de maquina de estados de LangGraph es ideal para este tipo de pipeline de multiples pasos.

Los dos sistemas comparten una base de datos PostgreSQL. Los agentes del Agent SDK escriben registros de conversacion. El agente de LangGraph los lee para el analisis. Ningun sistema sabe ni le importa el framework del otro. La frontera es la base de datos, no el framework.

Este es el enfoque pragmatico. No elijas un bando. Elige la herramienta adecuada para cada problema especifico.

Ecosistema y comunidad

Un factor que merece su propia seccion es el tamano de la comunidad. LangChain tiene una comunidad significativamente mayor. Mas tutoriales, mas respuestas en Stack Overflow, mas ejemplos en GitHub, mas integraciones de terceros. Cuando te atascas, las probabilidades de encontrar a alguien que haya resuelto tu problema especifico son mayores con LangChain.

La comunidad del Agent SDK es mas pequena pero esta creciendo rapidamente. Tiene la ventaja de estar mantenida directamente por Anthropic, lo que significa que la documentacion es autorizada y los problemas los abordan las personas que construyen Claude. La contrapartida son menos ejemplos e integraciones contribuidos por la comunidad.

Para equipos evaluando ambas opciones, esta es una consideracion practica. Un desarrollador junior encontrara mas recursos de aprendizaje de LangChain. Un desarrollador senior apreciara la API limpia y la superficie minima del Agent SDK. Considera el nivel de experiencia de tu equipo y las expectativas de soporte de tu organizacion al tomar la decision.

El ecosistema de codigo abierto alrededor de cada herramienta tambien importa. LangChain tiene LangSmith para observabilidad, LangServe para despliegue y LangGraph para flujos de trabajo complejos. Estos forman una plataforma cohesiva.

El Agent SDK es mas enfocado, proporcionando el bucle central del agente y dejando el despliegue, la observabilidad y la orquestacion de flujos de trabajo a tu infraestructura existente. Ambos enfoques tienen merito. El enfoque de plataforma reduce decisiones. El enfoque enfocado reduce el acoplamiento.

La leccion

La eleccion entre el Agent SDK y LangChain no es sobre calidad. Ambos estan bien mantenidos, bien documentados y son usados en produccion por miles de desarrolladores. La eleccion es sobre ajuste.

Cuando construyas un agente impulsado por Claude que necesite ser fiable, rapido y simple, elige el Agent SDK. Cuando construyas un flujo de trabajo complejo que pueda necesitar multiples modelos, gestion elaborada de estado o docenas de integraciones, elige LangChain.

La peor decision es elegir basandose en el hype. Hemos visto equipos adoptar LangChain porque "todos lo usan" y luego luchar con abstracciones que no necesitan. Hemos visto equipos evitar el Agent SDK porque es "demasiado simple" y luego reconstruir sus funcionalidades desde cero sobre LangChain.

Empieza con el problema. ¿Que necesita hacer tu agente? ¿Cuantos modelos necesita? ¿Que tan complejo es el flujo de trabajo?

¿Que tan importante es la sobrecarga minima? Responde esas preguntas y la eleccion de framework se vuelve obvia.

Conclusion

Escribimos esta guia porque demasiadas comparaciones hacen benchmarks de ejemplos hola-mundo y declaran un ganador. El desarrollo real de agentes es mas desordenado que eso. El framework correcto depende de tu equipo, tus requisitos y tu infraestructura existente.

El Agent SDK es excelente para lo que hace. Te da una forma limpia, minima y optimizada para Claude de construir agentes con herramientas, guardrails y handoffs. Para profundizar mas, nuestra guia sobre construir un agente personalizado de Claude recorre un ejemplo de produccion completo.

LangChain es excelente para lo que hace. Te da una forma flexible, agnóstica de modelo y rica en ecosistema para construir aplicaciones complejas con LLMs. Su comunidad es enorme y su biblioteca de integraciones no tiene rival.

Usa el que encaje. O usa ambos. Al agente no le importa que framework lo construyo. Al usuario no le importa que framework lo construyo. Lo que importa es que el agente funcione, que funcione de forma fiable, y que puedas mantenerlo cuando las cosas vayan mal.